Temas de IA: Modelo SpikingBrain AI publicado

Fuente de imagen: ChatGPT-5

Un nuevo avance en IA inspirada en el cerebro

Puntos clave

- SpikingBrain 1.0 imita cómo el cerebro humano procesa información. Usa neuronas de impulso que se activan solo cuando es necesario, haciéndolo más eficiente.

- Los investigadores entrenaron modelos de 7B y 76B parámetros usando menos del 2% de los datos utilizados en sistemas de IA convencionales.

- El modelo 7B procesó prompts de 4 millones de tokens a una velocidad 100 veces mayor que los modelos típicos.

- Ambos modelos fueron entrenados y probados completamente en GPUs MetaX, demostrando que China puede construir IA avanzada sin NVIDIA.

- Una demo pública llamada "Shunxi" permite a cualquiera probar el modelo SpikingBrain en línea.

SpikingBrain: Un nuevo modelo alternativo inspirado en el cerebro

Un equipo de investigación en Beijing presentó SpikingBrain 1.0, un sistema de IA diseñado para imitar más de cerca cómo funciona el cerebro humano.

A diferencia de los modelos de lenguaje grandes (LLMs) actuales que mantienen todas las neuronas en un estado "siempre encendido", las neuronas de SpikingBrain se activan solo cuando es necesario.

Este enfoque, combinado con mecanismos de atención híbridos y escalado de Mezcla de Expertos (MoE), hace que el sistema sea mucho más rápido y eficiente.

El entrenamiento muestra mayor velocidad con menos datos

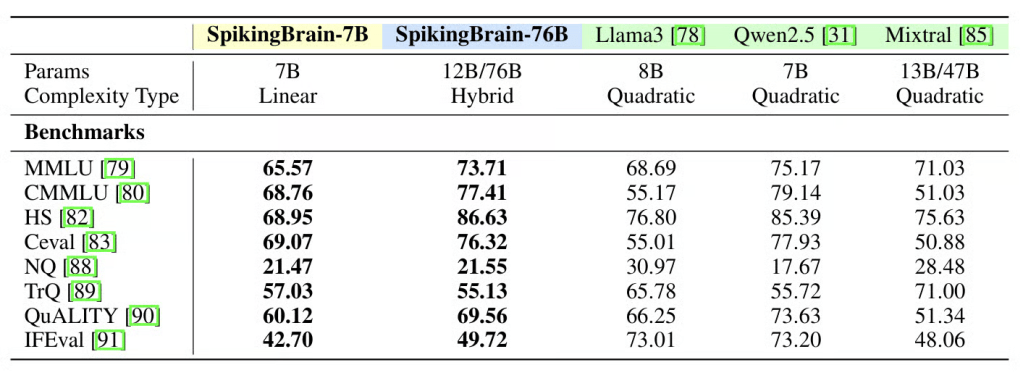

SpikingBrain viene en dos versiones: el SpikingBrain-7B más pequeño diseñado para eficiencia, y el SpikingBrain-76B más grande construido para mayor precisión.

Ambos modelos fueron entrenados con aproximadamente 150 mil millones de tokens — menos del 2% de los datos típicamente usados para modelos de lenguaje modernos.

El SpikingBrain-7B procesó prompts de 4 millones de tokens más de 100 veces más rápido que los modelos transformadores típicos mientras mantenía estabilidad durante semanas.

El SpikingBrain-76B más grande usa una arquitectura híbrida de Mezcla de Expertos, reduciendo significativamente la brecha con los modelos transformadores principales y en algunos casos igualando o superando sistemas ampliamente usados como Llama2-70B, Mixtral-8x7B y Gemma2-27B.

Independencia de hardware: Un sistema que funciona con chips MetaX

Uno de los logros más notables es que los investigadores entrenaron SpikingBrain exclusivamente en cientos de GPUs MetaX C550 chinas, no en hardware NVIDIA.

Esta independencia es particularmente significativa dadas las preocupaciones continuas sobre las cadenas de suministro de chips y la independencia tecnológica nacional.

Demo Shunxi disponible para usuarios generales

Los investigadores publicaron como código abierto el modelo SpikingBrain-7B más pequeño a través de GitHub.

También introdujeron Shunxi, una demo pública del SpikingBrain-76B estrella, para demostrar las capacidades del sistema más grande.

Implicaciones

El lanzamiento de SpikingBrain destaca tres cambios importantes:

Eficiencia sobre escala

El diseño inspirado en el cerebro muestra que las mejoras de rendimiento no siempre requieren conjuntos de datos más grandes o costos más altos.

La diversificación de hardware está en marcha

Al demostrar que las GPUs MetaX pueden ejecutar modelos avanzados, China reduce su dependencia de fabricantes de chips occidentales.

La competencia global se intensifica

A medida que múltiples países construyen sus propios sistemas de IA y hardware, el panorama se vuelve más diverso y competitivo.

Estos nuevos desarrollos prometen sistemas más rápidos, más baratos y más eficientes energéticamente, remodelando cómo y dónde se construyen los modelos de lenguaje grandes.

Blog de IMPAKERS | ¿Microsoft Office 365 anuncia integración de Claude Sonnet 4? Leer más

Fuente: Alicia Shapiro, AiNews, "China's New SpikingBrain AI Models Deliver Speed and Efficiency on Domestic Chips", https://www.ainews.com/p/china-s-new-spikingbrain-ai-models-deliver-speed-and-efficiency-on-domestic-chips, (2025-09-15)